Deepfake to rodzaj sztucznej inteligencji, którą wykorzystuje się do tworzenia przekonujących obrazów, dźwięków i filmów. Uzyskane w ten sposób materiały bywają częścią skomplikowanych oszustw.

Określenie deepfake odnosi się zarówno do samej technologii jak i do tworzonych przy jej pomocy treści. Samo słowo powstało z połączenia terminów deep learning i fake.

Deepfake AI często przekształca istniejącą treść źródłową, podmieniając występującą w niej osobę. Możliwe jest też tworzenie całkowicie nowych treści, w których ktoś robi lub mówi coś, czego w rzeczywistości nigdy nie robił ani nie mówił.

Największym zagrożeniem, jakie wiąże się z technologią deep fake jest możliwość rozpowszechniania fałszywych informacji, które noszą wszelkie znamiona prawdy i wydają się pochodzić z wiarygodnych źródeł. Na przykład w roku 2022 pojawił się deepfake’owy filmik, na którym prezydent Ukrainy, Wołodymyr Zełenski, wzywa swoje wojsko do kapitulacji.

Słychać też obawy, że przy pomocy technologii deepfake można zmanipulować wyniki wyborów i tworzyć przedwyborczą propagandę. Choć ten rodzaj sztucznej inteligencji bez wątpienia niesie ze sobą poważne ryzyko, trzeba przyznać, że technologia ma też całkiem niewinne, a nawet pozytywne zastosowania. Służy na przykład do tworzenia dźwięków do gier i materiałów rozrywkowych, jest wykorzystywana w aplikacjach do obsługi klienta i call center, przekazuje połączenia i pełni rolę recepcji.

Jak działa deepfake?

Technologia deepfake wykorzystuje dwa algorytmy: jeden z nich to generator, a drugi dyskryminator. Służą one do tworzenia i modelowania fałszywych treści. Generator buduje zestaw danych treningowych na podstawie pożądanych rezultatów, tworząc początkową fałszywą treść, zaś dyskryminator sprawdza, czy powstały materiał jest realistyczny. Ten proces powtarza się, dzięki czemu generator tworzy coraz lepsze i bardziej realistyczne treści, zaś dyskryminator coraz sprawniej rozpoznaje defekty generatora.

Połączenie obu algorytmów tworzy sieć generatywną, znaną jako GAN (ang. generative adversarial network). Sieć GAN wykorzystuje proces deep learning do rozpoznawania wzorów w rzeczywistych obrazach, a następnie na podstawie tych wzorów tworzy fałszywy materiał.

Tworząc deepfake’owe zdjęcie system GAN przegląda fotografie docelowego obiektu, zrobione pod różnym kątem, by uchwycić wszystkie szczegóły i uwzględnić każdą perspektywę. W przypadku filmów GAN przegląda nagrania z różnych perspektyw i analizuje wzorce zachowania, ruchu i mowy. Następnie informacje te kilkakrotnie przechodzą przez dyskryminator, by obraz lub film były jak najbardziej realistyczne.

Deepfake’owe filmy można tworzyć na dwa sposoby. Po pierwsze, można wykorzystać oryginalne nagranie źródłowe i zmodyfikować zachowanie osoby, która w nim występuje. Po drugie, można wstawić twarz danej osoby do zupełnie innego nagrania. Ta druga technika jest znana jako face swap.

Poniżej przybliżamy konkretne metody tworzenia deepfake’ów:

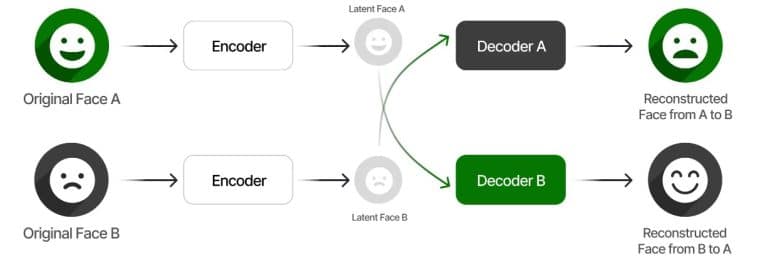

- Deepfake nagrania źródłowego. Pracując na nagraniu źródłowym, autoenkoder oparty na sieci neuronowej analizuje jego treść, by wychwycić istotne atrybuty obiektu docelowego, na przykład mimikę czy język ciała. Następnie przekłada te atrybuty do oryginalnego nagrania. Autoenkoder składa się z enkodera, który koduje istotne atrybuty, i dekodera, który przenosi je do nagrania docelowego.

- Deepfake audio. W przypadku deepfake’ów audio system GAN klonuje nagranie głosu danej osoby, tworzy model oparty na wzorach głosowych, a następnie wykorzystuje go tak, by uzyskany głos wypowiedział dowolne słowa. Z tej techniki powszechnie korzystają projektanci gier wideo.

- Lip-sync. Lip-sync to kolejna popularna technika tworzenia deepfake’ów. W tym przypadku deepfake AI mapuje nagranie głosowe i dopasowuje je do warstwy wizualnej. Efekt końcowy wygląda tak, jak gdyby osoba na filmie mówiła tekst podłożony w nagraniu. Jeśli sama warstwa dźwiękowa już jest deepfake’m, wówczas film dokłada dodatkową warstwę, mającą ukryć fałszerstwo. Tę technikę wspierają rekurencyjne sieci neuronowe.

Aby deepfake mógł być uznany za sukces, musi skutecznie nabrać algorytm dyskryminacyjny.

Technologia potrzebna do tworzenia deepfake’ów

Jedno jest pewne: tworzenie deepfake’ów jest coraz łatwiejsze, a sam materiał – coraz bardziej precyzyjny i realistyczny. Pomagają w tym następujące technologie:

- Technologia sieci neuronowych GAN służy do tworzenia wszystkich treści deepfake’owych. Jak pisaliśmy wcześniej, opiera się na wykorzystaniu generatora i dyskryminatora.

- Konwolucyjne sieci neuronowe analizują wzory z danych wizualnych. Tego typu sieci są wykorzystywane do rozpoznawania twarzy i śledzenia ruchu.

- Autoenkodery to technologia sieci neuronowych, która identyfikuje odpowiednie atrybuty, na przykład wyraz twarzy czy język ciała, a następnie nakłada je na nagranie źródłowe.

- Przetwarzanie języka naturalnego (natural language processing, NLP) wykorzystuje się do tworzenia deepfake’ów audio. Algorytmy NLP analizują atrybuty mowy, a następnie generują oryginalny tekst z wykorzystaniem tych atrybutów.

- High-performance computing (HPC) to praktyka agregowania mocy obliczeniowej w sposób, który zapewnia znaczne osiągi wymagane do tworzenia i utrzymania deepfake’ów.

Z raportu amerykańskiego Departamentu Bezpieczeństwa Krajowego, zatytułowanego Rosnące zagrożenie związane z deepfake’owymi tożsamościami wynika, że istnieją narzędzia umożliwiające tworzenie deepfake’ów w kilka sekund. Wśród nich można wymienić na przykład Deep Art Effects, Deepswap, Deep Video Portraits, FaceApp, FaceMagic, MyHeritage, Wav2Lip, Wombo i Zao.

Do czego wykorzystuje się technologię deepfake?

Deep fake AI może mieć różnorodne zastosowania. Do najważniejszych możemy zaliczyć takie obszary jak:

- Sztuka. To w ten sposób powstają nowe utwory na bazie istniejącego repertuaru danego artysty.

- Szantaż i szkody na reputacji. Dzieje się tak wtedy, kiedy czyjś wizerunek zostaje wstawiony do nagrania przedstawiającego nielegalne, nieprzyzwoite lub kompromitujące sytuacje. Następnie takie nagrania mogą być użyte do szantażowania ofiary, zrujnowania jej reputacji, do zemsty lub po prostu do dręczenia niewinnej osoby.

- Przyjmowanie zgłoszeń telefonicznych. Tego rodzaju centra usług wykorzystują technologię deep fake do udzielania spersonalizowanych odpowiedzi na zgłoszenia telefoniczne. Usługi te obejmują przekierowywanie połączeń, przekazywanie i inne usługi, jakie zwykle świadczy recepcja lub call centre.

- Telefoniczna obsługa klienta. Te usługi korzystają z deepfake’owych nagrań głosowych do prostych zadań, takich jak sprawdzanie salda czy przyjmowanie reklamacji.

- Rozrywka. Do filmów i gier wideo klonuje się głosy aktorów, by następnie wykorzystać je w innych scenach. Robi się tak na przykład wtedy, kiedy daną scenę trudno jest nakręcić na żywo. Deepfake wprowadza się na etapie postprodukcji, kiedy aktora nie ma już na planie filmowym. Technologia przydaje się także do różnego rodzaju parodii.

- Fałszywe dowody. To poważniejsza sprawa. W takich przypadkach deepfake słuzy do fabrykowania dowodów, które mogą wskazywać na czyjąś winę lub niewinność.

- Oszustwa i wyłudzenia. Przy pomocy technologii deepfake można się pod kogoś podszyć, by wyłudzić informacje dotyczące rachunku bankowego lub numer karty kredytowej. Do takich nadużyć dochodzi często, gdy oszuści podszywają się pod dyrektorów przedsiębiorstw lub pracowników, którzy mają dostęp do danych wrażliwych.

- Wprowadzenie w błąd i manipulacja polityczna. Już od jakiegoś czasu w sieci krążą fałszywe nagrania polityków lub zaufanych źródeł, mające zachwiać opinią publiczną, a czasem wręcz doprowadzić do poważnego zagrożenia konfliktem zbrojnym. To tak zwane fake newsy.

- Manipulacje giełdowe. Sfabrykowane materiały deep fake mogą też posłużyć do manipulacji ceną akcji danej firmy. Fałszywe nagranie, na którym członek zarządu podaje szkodliwe informacje na temat działalności przedsiębiorstwa, mogą istotnie zaniżyć wartość jego akcji.

- Wiadomości tekstowe. Wspomniany już raport Departamentu Bezpieczeństwa Stanów Zjednoczonych podaje, że w przyszłości technologia deepfake AI będzie wykorzystywana do wiadomości tekstowych. Sprytni oszuści będą w stanie skopiować nawet czyjś styl pisania.

Czy technologia deepfake jest legalna?

Sama technologia jest legalna. Ustawodawca nie ma mocy, by jej zakazać, nawet jeśli wiadomo, że wiąże się z nią ryzyko. Deepfake AI jest nielegalna tylko wówczas, gdy narusza obowiązujące przepisy prawne, na przykład służy do rozpowszechniania mowy nienawiści, zniesławienia lub dystrybucji nieprzyzwoitych materiałów zakazanych przez prawo.

W Polsce na razie brak jeszcze przepisów regulujących wykorzystanie technologii deep fake. Na straży porządku stoją wyłącznie dotychczasowe regulacje w zakresie ochrony danych osobowych i praw autorskich. Nie ulega jednak wątpliwości, że przyszłość wymusi nowe rozwiązania również w sferze prawa. Póki co jednak ofiary oszustw z wykorzystaniem materiałów deepfake’owych pozbawione są znaczącej ochrony.

Na czym polega zagrożenie ze strony technologii deepfake?

Deepfake’owe materiały mogą nieść ze sobą różnego rodzaju ryzyko, na przykład:

- Szantaż i szkody dla reputacji, jeśli materiały deepfake’owe ukazują daną osobę w kompromitującej sytuacji, nawet jeśli nie miała ona miejsca w rzeczywistości.

- Dezinformacja polityczna, jeśli w usta znanych polityków wkłada się fałszywe treści.

- Manipulacja wyborcza, m.in. tworzenie fałszywych nagrań kandydatów.

- Manipulacje giełdowe, kiedy fałszywe treści wpływają na cenę akcji.

- Wyłudzenia, kiedy ktoś podszywa się pod drugą osobę, by uzyskać jej dane wrażliwe, takie jak informacje dotyczące rachunku bankowego.

Metody wykrywania deepfake’ów

Istnieje kilka dobrych praktyk, które warto mieć na uwadze, jeśli chcemy wykryć atak deepfake. Poniżej podajemy kilka sygnałów, które wskazują na możliwość wykorzystania technologii deep fake:

| Materiał wideo | Materiał tekstowy |

|

|

Trzeba jednak pamiętać, że sztuczna inteligencja również coraz sprawniej podszywa się pod treści tworzone przez człowieka w naturalnym kontekście. Niedługo prawdopodobnie powstanie narzędzie, które wyeliminuje problem braku mrugania.

Jak bronić się przed deepfake’owymi oszustwami?

Przedsiębiorstwa, organizacje i organy rządowe wciąż pracują nad rozwiązaniami, które umożliwiałyby identyfikację i blokowanie treści deepfake’owych. Niektóre platformy społecznościowe wykorzystują technologię blockchain do weryfikacji źródła zamieszczanych filmów i obrazów. W ten sposób ustala się, które źródła są wiarygodne, jednocześnie blokując materiały, które noszą znamiona deepfake AI. Na tej zasadzie portale takie jak Facebook czy Twitter zakazały złośliwych deepfake’ów.

Niektórzy producenci oprogramowania mają już w ofercie rozwiązania chroniące przed technologią deepfake.

- Adobe ma system, który pozwala twórcom opatrywać filmy i obrazy podpisem.

- Microsoft ma oparte na sztucznej inteligencji rozwiązanie wykrywające deepfake, które analizuje nagrania i zdjęcia, a następnie oblicza prawdopodobieństwo manipulacji.

- Operation Minerva wykorzystuje katalogi zdemaskowanych już deepfake’ów, by stwierdzić, czy nowy film jest modyfikacją istniejącego fejkowego nagrania, które już znajduje się w bazie.

- Sensity oferuje platformę, która korzysta z mechanizmu deep learning, by wykrywać sygnały wskazujące na deepfake. Rozwiązanie działa podobnie jak antywirus wykrywający złośliwe oprogramowanie. Użytkownicy otrzymują powiadomienia mailem, kiedy natrafią na deepfake.

Znane przykłady deepfake’ów

- Założyciel Facebooka, Mark Zuckerberg, stał się ofiarą takiego ataku, kiedy pojawiło się deepfake’owe nagranie, na którym wypowiadał się na temat potęgi big data i chwalił się, że Facebook kontroluje swoich użytkowników. Nagranie miało pokazać, jak ludzie mogą wykorzystywać platformy społecznościowe do oszukiwania społeczeństwa.

- Prezydent Stanów Zjednoczonych Joe Biden również padł ofiarą licznych deepfake’ów w roku 2020, kiedy to pokazano go w stanie zbliżonym do demencji, co miało wpłynąć na wyniki wyborów prezydenckich.

- W 2022 roku, kiedy Rosja napadła na Ukrainę, prezydent Ukrainy Wołodymyr Zełenski pojawił się w deepfake’owym filmie, na którym zachęcał wojska ukraińskie do kapitulacji.

Historia i przyszłość technologii deepfake AI

Deepfake AI to nowa technologia, ktora ma swoje początki w niewinnym, zdawałoby się, obrabianiu zdjęć w programie Adobe Photoshop. W drugiej dekadzie XXI wieku tania moc obliczeniowa, duże zbiory danych, sztuczna inteligencja i uczenie się maszyn doprowadziły do ulepszenia algorytmów deep learning.

W 2014 roku zaś Ian Goodfellow z Uniwersytetu Montrealskiego opracował system GAN, który stał się podstawą tworzenia deepfake’owych treści. Nieco później anonimowy użytkownik Reddita o nicku Deepfakes zaczął wypuszczać podrobione filmy z celebrytami w roli głównej. Zaprezentował też narzędzie GAN, które umożliwiało podmienianie twarzy w nagraniach wideo. To ostatnie rozwiązanie błyskawicznie przyjęło się wśród użytkowników mediów społecznościowych.

W końcu kto nie robił face swapa z kotem? Gdy jednak okazało się, że deepfake to nie tylko zabawa, ale też potężna broń i narzędzie do nadużyć, organizacje zaczęły podejmować kroki w celu ochrony przed zagrożeniem. Skoro nie da się wrócić do czasów sprzed technologii deepfake, trzeba ją jakoś oswoić i umieścić w bezpiecznych ramach technologiczno-prawnych. I to będzie z pewnością zadanie dla obecnego i następnego pokolenia.

Źródła: